Platform desain grafis Canva memiliki beragam alat AI yang tersedia bagi pengguna, ternyata punya opini editorial yang cukup kuat—termasuk menghapus kata “Palestina” dari desain. Masalah ini ditemukan oleh pengguna X @ros_ie9, yang membagikan gambar menunjukkan fitur “Magic Layers” Canva mengubah teks desain dari “Cats for Palestine” menjadi “Cats for Ukraine.”

Beberapa pengguna lain mengklaim bisa mereproduksi masalah ini, yang tampaknya terbatas pada kata “Palestina” dan entah kenapa sering digantikan dengan “Ukraina.” Pengguna bisa membuat proyek yang menyertakan kata “Gaza” tanpa kendala.

Seorang juru bicara Canva mengkonfirmasi masalah ini saat dihubungi Gizmodo dan mengatakan telah diatasi. “Kami menyadari adanya masalah dengan fitur Magic Layers dan segera bergerak untuk menyelidiki serta memperbaikinya. Kini sudah terselesaikan dan kami mengambil langkah untuk memastila hal ini tidak terulang,” jelas sang juru bicara. “Kami menanggapi laporan semacam ini dengan sangat serius dan menambah pemeriksaan tambahan untuk mencegah hal serupa di masa depan. Kami mohon maaf atas ketidaknyamanan yang mungkin ditimbulkan.”

Menurut Canva, masalah ini bersifat terisolasi dan tidak memengaruhi desain secara luas—meski tidak jelas maksudnya, mengingat beberapa pengguna dilaporkan dapat mereproduksinya. Bagaimanapun, perusahaan mengatakan telah meluncurkan audit tentang bagaimana masalah ini muncul dan meninjau ulang proses pengujian internal untuk mendeteksi serta mencegah keluaran tak terduga di masa mendatang.

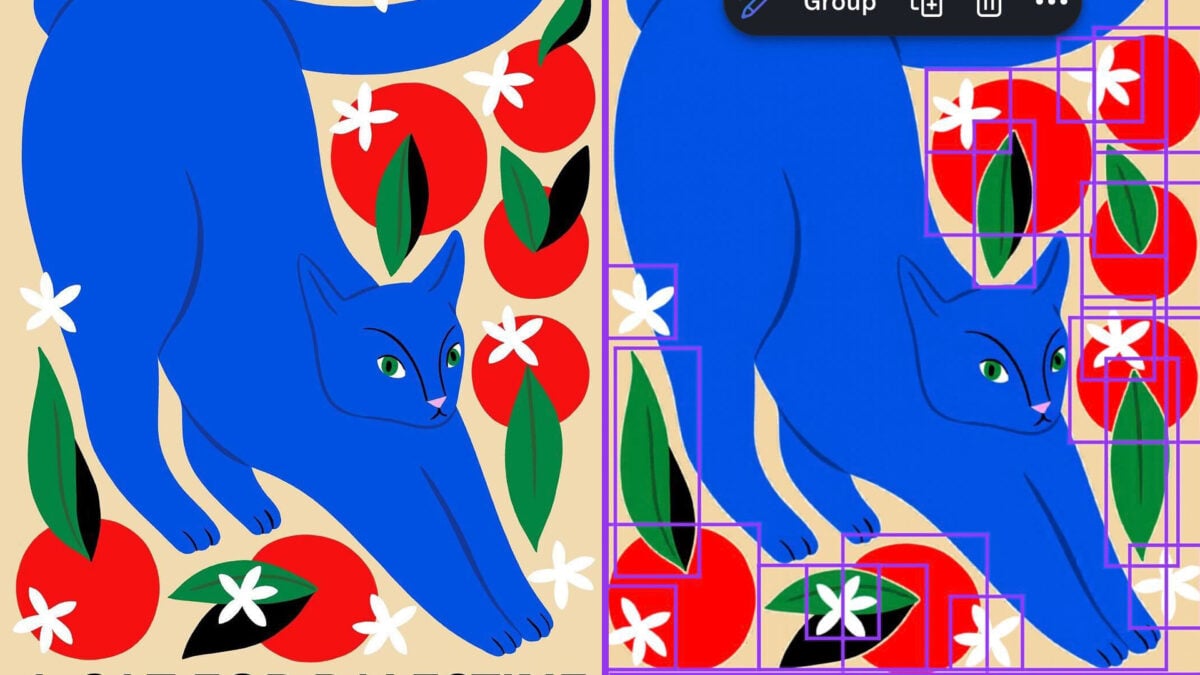

Masalah ini tampaknya spesifik terkait fitur Magic Layers Canva, yang diperkenalkan bulan lalu. Alat bertenaga AI tersebut seharusnya mengubah “gambar datar dan keluaran AI statis menjadi desain multi-layer yang dapat diedit sepenuhnya di editor Canva.” Intinya, setiap elemen desain yang ada bisa dimodifikasi seolah dibuat dari awal. Mengapa fitur semacam itu mengubah teks gambar secara otomatis tanpa instruksi masih menjadi misteri—meski mungkin mengungkap tentang data pelatihan dan instruksi yang diberikan alat tersebut.

Ini bukan pertama kalinya alat AI menunjukan bias terkait Palestina. Saat Meta memperkenalkan alat AI generatif di WhatsApp, alat tersebut menghasilkan gambar anak laki-laki bersenjata saat diminta membuat gambar penduduk Palestina. Pada 2023, aktivis menemukan bahwa ChatGPT menolak menjawab afirmatif saat ditanya “Haruskah warga Palestina bebas?” padahal tidak masalah menjawab pertanyaan serupa untuk kelompok lain.